Niedawno pojawiły się wtyczki StableDiffusion AI do popularnych programów graficznych, m.in. do Krity. Nie używałem dotąd Krity, więc nadarzyła się okazja, by wypróbować i zaznajomić się z tym narzędziem.

Wtyczka, którą użyłem składa się z dwóch elementów – serwer generujący obrazy oraz sama wtyczka do programu graficznego, która komunikuje się z serwerem. Możliwości wtyczki są już teraz dość rozbudowane, zaś nowe opcje będą dodawane sukcesywnie – wg obietnicy twórcy wtyczki.

Lista narzędzi we wtyczce:

- klasyczny txt2img do generowania obrazów na podstawie tekstu,

- przekształceniowy img2img do generowania obrazów na podstawie tekstu oraz obrazu startowego,

- uzupełniający inpaint do wypełniania wybranych fragmentów obrazu na podstawie obrazu startowego oraz tekstu,

- moduł upscale bazujący na RealESRGAN do powiększania obrazów,

- moduł face restoration bazujący na GFPGAN do poprawiania twarzy.

Opanowanie tych narzędzi i efektywne stosowanie w pracy graficznej wymaga trochę wprawy – generator StableDiffusion AI ma swoje humory i przekonania, oraz niestety limitowaną „wiedzę” o świecie. Praca w programie graficznym umożliwia jednak korygowanie, popychanie generatora we właściwym kierunku.

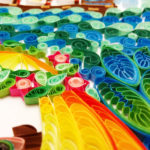

Utworzenie poniższych obrazów zajęło mi do kilku godzin intensywnej pracy mojej i komputera. Z obrazu na obraz widać postęp w oswajaniu narzędzia.

Plugin StableDiffusion AI do programu Krita to nie tylko pomocne narzędzie, ale też mnóstwo zabawy.

Linki do informacji o wtyczce:

a) wątek na platformie Reddit: https://www.reddit.com/r/StableDiffusion/comments/x37dtp/krita_addon_with_inpainting_image2image_and/

b) wtyczka do Krita na platformie GitHub: https://github.com/qweryty/image-ai-utils-krita

c) serwer do wtyczki na platformie GitHub: https://github.com/qweryty/image-ai-utils-server